Trong thời đại công nghệ ngày nay, sự phát triển của trí tuệ nhân tạo (AI) đã tạo ra những bước tiến lớn trong việc xử lý ngôn ngữ tự nhiên. Một trong những đột phá quan trọng nhất là sự xuất hiện của Mô hình ngôn ngữ lớn (Large Language Model – LLM), một loại mô hình AI có khả năng xử lý và tạo ra văn bản phức tạp, gần giống với ngôn ngữ tự nhiên của con người.

Giới thiệu về mô hình ngôn ngữ lớn LLM

Khái niệm về mô hình ngôn ngữ lớn LLM

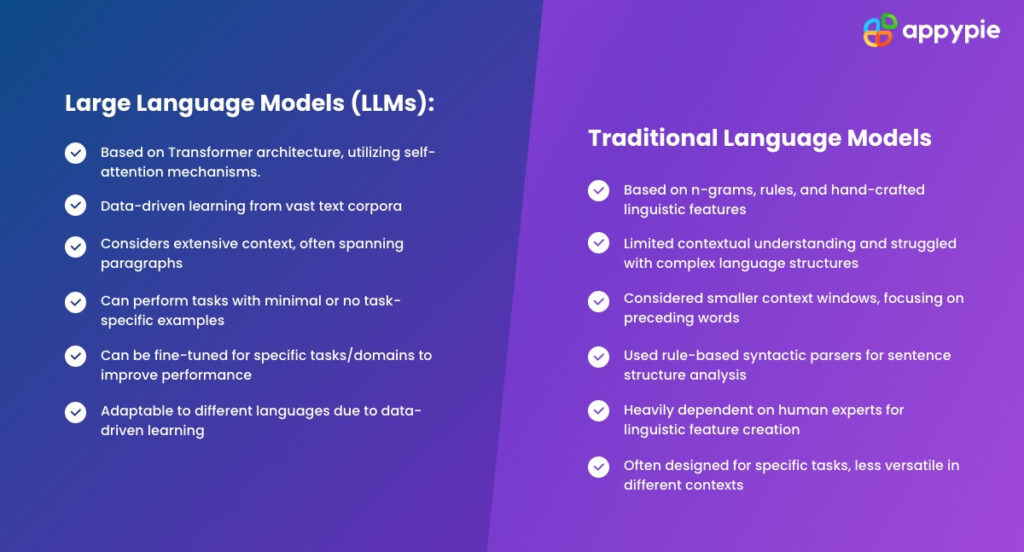

Mô hình ngôn ngữ lớn (LLM) là một loại mô hình trí tuệ nhân tạo (AI) được đào tạo trên một lượng lớn dữ liệu văn bản để tạo ra và xử lý ngôn ngữ tự nhiên. Không giống như các mô hình ngôn ngữ truyền thống hạn chế hơn, LLM có khả năng học và tái tạo các mẫu ngôn ngữ phức tạp, bao gồm ngữ pháp, cú pháp và ngữ nghĩa.

Lịch sử phát triển của LLM

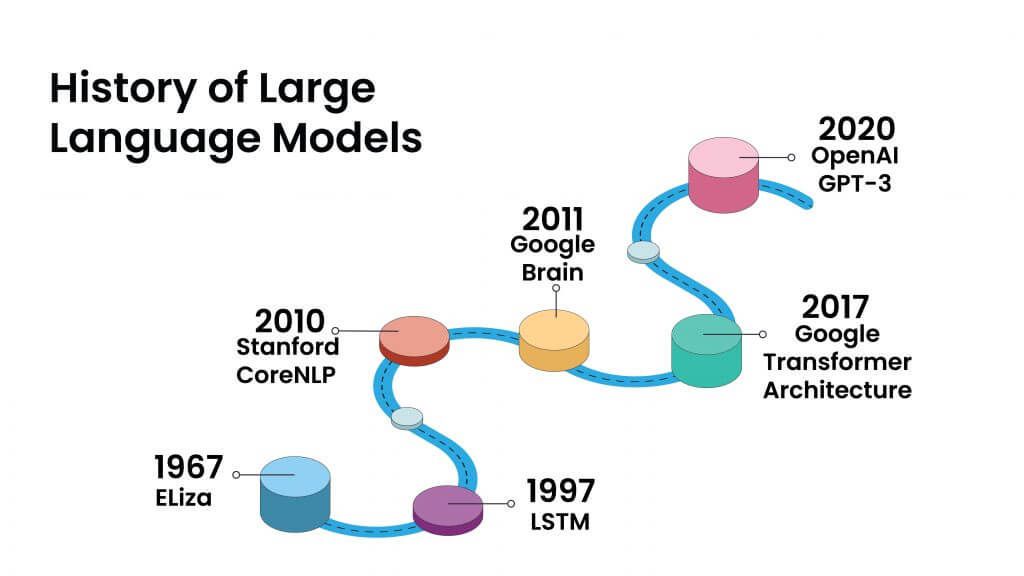

Việc phát triển LLM đã trải qua một quá trình dài với nhiều bước tiến quan trọng:

- Những năm 2010: Sự ra đời của các mô hình ngôn ngữ lớn đầu tiên như Word2Vec và GloVe.

- Năm 2017: Mô hình Transformer được giới thiệu, mở ra một giai đoạn mới trong phát triển LLM.

- Năm 2018: GPT (Generative Pre-trained Transformer) – mô hình ngôn ngữ tiền huấn luyện đầu tiên được giới thiệu bởi OpenAI.

- Năm 2019: BERT (Bidirectional Encoder Representations from Transformers) được phát triển bởi Google, đánh dấu một bước ngoặt quan trọng trong lĩnh vực xử lý ngôn ngữ tự nhiên.

- Năm 2020: GPT-3, một LLM khổng lồ với 175 tỷ tham số, được công bố bởi OpenAI, tạo ra sự đột phá mới trong việc tạo và xử lý ngôn ngữ tự nhiên.

Tầm quan trọng của LLM trong xử lý ngôn ngữ tự nhiên

LLM đóng một vai trò quan trọng trong lĩnh vực xử lý ngôn ngữ tự nhiên (NLP) vì khả năng mạnh mẽ của chúng trong việc hiểu và tạo ra ngôn ngữ tự nhiên. Chúng có thể được ứng dụng trong nhiều lĩnh vực khác nhau như tạo văn bản, dịch ngôn ngữ, trả lời câu hỏi và tóm tắt văn bản, giúp giải quyết các vấn đề liên quan đến ngôn ngữ tự nhiên một cách hiệu quả.

Cấu trúc của Mô hình ngôn ngữ lớn LLM

Kiến trúc mạng nơ-ron hồi quy (RNN)

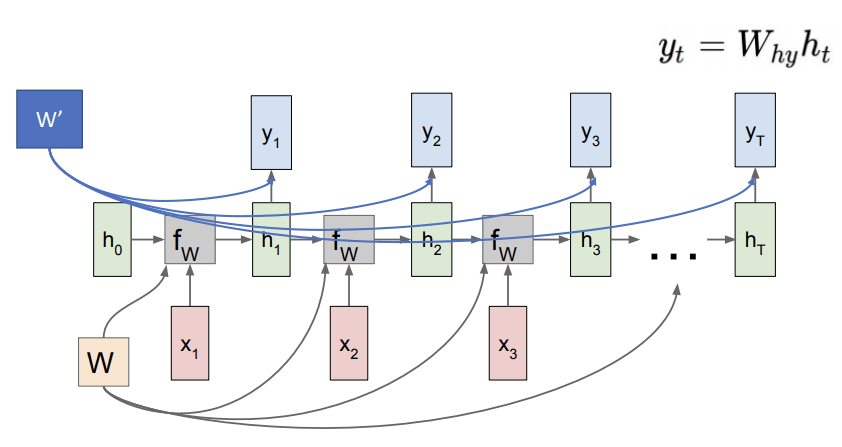

Một số LLM được xây dựng dựa trên kiến trúc mạng nơ-ron hồi quy (Recurrent Neural Network – RNN), chẳng hạn như LSTM (Long Short-Term Memory). Các mô hình này học cách dự đoán từ tiếp theo trong một chuỗi ký tự, dựa trên bối cảnh trích xuất từ văn bản đã cho.

Ưu điểm của RNN

- Có khả năng học và xử lý dữ liệu tuần tự, phù hợp cho các ứng dụng xử lý ngôn ngữ tự nhiên.

- Tính linh hoạt và khả năng điều chỉnh kích thước mô hình.

Nhược điểm của RNN

- Vấn đề đà tàn lưu gradient (vanishing/exploding gradient) trong quá trình huấn luyện.

- Khó khăn trong việc song song hóa tính toán, ảnh hưởng đến hiệu suất.

Kiến trúc Transformer

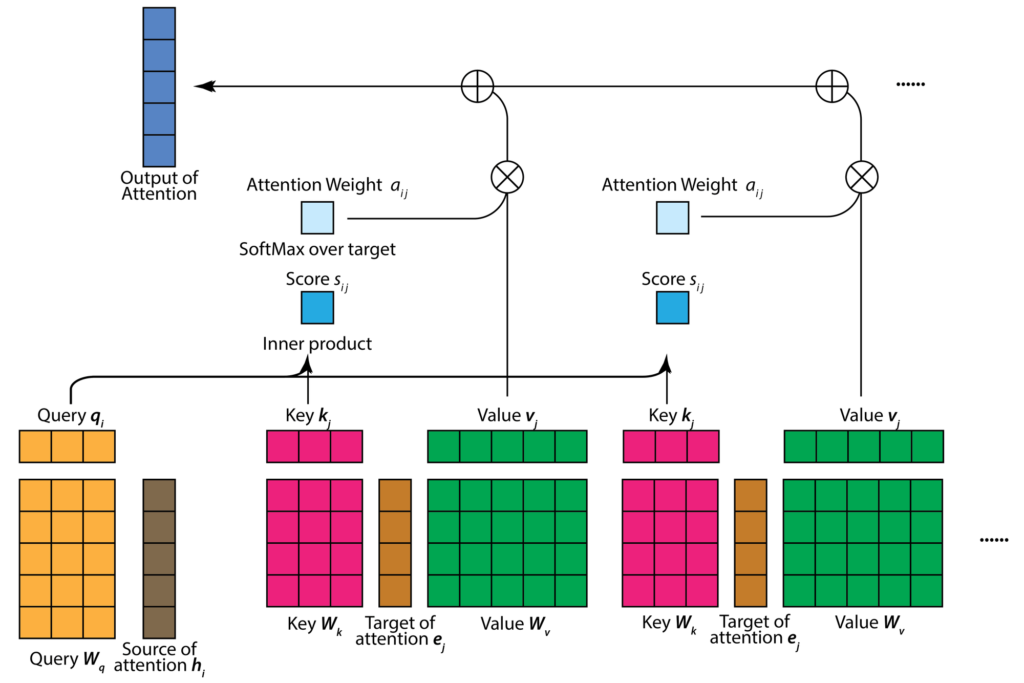

Một số LLM khác được xây dựng dựa trên kiến trúc Transformer, một kiến trúc mạng nơ-ron đột phá giúp giải quyết các vấn đề của RNN. Transformer sử dụng cơ chế tự chú ý (self-attention) để học các mối quan hệ giữa các phần tử trong chuỗi dữ liệu.

Ưu điểm của Transformer

- Khắc phục được vấn đề đà tàn lưu gradient của RNN.

- Tính toán song song hiệu quả hơn, phù hợp cho việc huấn luyện trên máy tính lớn.

- Khả năng xử lý các chuỗi dữ liệu dài tốt hơn.

Nhược điểm của Transformer

- Yêu cầu nhiều tài nguyên tính toán hơn so với RNN.

- Số lượng tham số lớn, khó huấn luyện trên dữ liệu nhỏ.

Cả RNN và Transformer đều được sử dụng trong việc xây dựng các LLM, với những ưu và nhược điểm riêng. Lựa chọn kiến trúc phù hợp phụ thuộc vào yêu cầu cụ thể và nguồn lực có sẵn.

Quá trình huấn luyện LLM

LLM được huấn luyện trên một lượng lớn dữ liệu văn bản, thường là hàng tỷ từ, để học cách dự đoán từ tiếp theo trong một chuỗi ký tự . Quá trình huấn luyện LLM thường bao gồm các bước sau:

- Thu thập dữ liệu: Dữ liệu văn bản được thu thập từ các nguồn đa dạng trên Internet hoặc trong các cơ sở dữ liệu ngôn ngữ.

- Tiền xử lý dữ liệu: Dữ liệu được tiền xử lý để loại bỏ nhiễu, chuẩn hóa và mã hóa thành dạng số học để mô hình có thể hiểu.

- Huấn luyện mô hình: Mô hình được huấn luyện trên dữ liệu đã tiền xử lý để học cách dự đoán từ tiếp theo trong chuỗi ký tự.

- Đánh giá mô hình: Mô hình được đánh giá thông qua các phương pháp đánh giá như perplexity, BLEU score, hay human evaluation để đảm bảo chất lượng.

- Tinh chỉnh mô hình: Sau khi đánh giá, mô hình có thể được tinh chỉnh để cải thiện hiệu suất trước khi triển khai vào ứng dụng thực tế.

Quá trình này đòi hỏi nhiều tài nguyên tính toán và thời gian, nhưng kết quả cuối cùng là một mô hình có khả năng xử lý và tạo ra văn bản tự nhiên với chất lượng cao.

Ứng dụng của Mô hình ngôn ngữ lớn LLM trong xử lý ngôn ngữ tự nhiên

Tạo văn bản

LLM có thể được sử dụng để tạo ra văn bản tự động, từ viết tin tức đến sáng tác văn xuôi. Các ứng dụng như chatbot, viết blog tự động, hoặc tóm tắt văn bản đều có thể được thực hiện bằng LLM.

Dịch ngôn ngữ

Với khả năng hiểu và tạo ra ngôn ngữ tự nhiên, LLM cũng có thể được áp dụng trong các hệ thống dịch ngôn ngữ tự động. Việc này giúp cải thiện chất lượng và tốc độ của dịch ngôn ngữ so với các phương pháp truyền thống.

Trả lời câu hỏi

LLM có thể được sử dụng để xây dựng các hệ thống trả lời câu hỏi tự động, giúp tìm kiếm thông tin nhanh chóng và chính xác từ các nguồn dữ liệu khác nhau.

Tóm tắt văn bản

Việc tóm tắt văn bản là một ứng dụng quan trọng của LLM, giúp rút ngắn văn bản dài thành các đoạn tóm tắt ngắn gọn và ý nghĩa.

Những ứng dụng trên chỉ là một phần nhỏ trong hàng ngàn cách mà LLM có thể được áp dụng trong xử lý ngôn ngữ tự nhiên, đem lại hiệu quả và tiện ích đáng kể cho nhiều lĩnh vực khác nhau.

So sánh giữa Mô hình ngôn ngữ lớn LLM và các mô hình khác

So sánh với mô hình ngôn ngữ truyền thống

- Ưu điểm của LLM:

- Khả năng học từ dữ liệu lớn một cách tự động.

- Hiểu ngữ nghĩa và cấu trúc ngôn ngữ tự nhiên tốt hơn.

- Độ chính xác cao hơn trong việc dự đoán và tạo ra văn bản.

- Nhược điểm của LLM:

- Đòi hỏi nhiều tài nguyên tính toán và dữ liệu huấn luyện.

- Có thể gặp vấn đề về đạo đức và bản quyền khi sử dụng trong một số ứng dụng.

So sánh với các mô hình LLM khác

- GPT-3:

- Ưu điểm: Số lượng tham số lớn, khả năng tạo ra văn bản phức tạp.

- Nhược điểm: Đòi hỏi tài nguyên tính toán cao, khó tinh chỉnh.

- BERT:

- Ưu điểm: Hiểu ngữ nghĩa hai chiều, phù hợp cho nhiều ứng dụng NLP.

- Nhược điểm: Hạn chế trong việc tạo văn bản mới.

- XLNet:

- Ưu điểm: Xử lý ngữ cảnh phức tạp, cải thiện hiệu suất.

- Nhược điểm: Đòi hỏi nhiều tài nguyên tính toán.

Mỗi loại mô hình LLM có những ưu và nhược điểm riêng, phù hợp với các ứng dụng và yêu cầu cụ thể trong xử lý ngôn ngữ tự nhiên.

Hướng phát triển của Mô hình ngôn ngữ lớn LLM

Mô hình ngôn ngữ lớn (LLM) đang ngày càng phát triển mạnh mẽ với sự ra đời của các phiên bản cải tiến như GPT-3, BERT, XLNet, và nhiều mô hình khác. Các hướng phát triển tiềm năng của LLM bao gồm:

- Tăng cường hiểu biết ngữ nghĩa: Phát triển các mô hình LLM có khả năng hiểu biết ngữ nghĩa và ngữ cảnh ngôn ngữ tự nhiên tốt hơn.

- Tối ưu hóa hiệu suất tính toán: Tìm cách giảm tải tính toán và tối ưu hóa hiệu suất của các mô hình LLM để có thể triển khai trên các ứng dụng thực tế.

- Mở rộng ứng dụng: Áp dụng LLM vào nhiều lĩnh vực mới như y tế, tài chính, giáo dục, và nhiều lĩnh vực khác để tận dụng tiềm năng của công nghệ.

- Nâng cao độ tin cậy và an toàn: Đảm bảo tính an toàn và độ tin cậy của các mô hình LLM trong việc xử lý thông tin và tương tác với con người.

Với những hướng phát triển này, Mô hình ngôn ngữ lớn (LLM) hứa hẹn sẽ tiếp tục đóng vai trò quan trọng trong lĩnh vực xử lý ngôn ngữ tự nhiên và mang lại nhiều ứng dụng hữu ích trong tương lai.

Kết luận

Trong bối cảnh phát triển mạnh mẽ của trí tuệ nhân tạo, Mô hình ngôn ngữ lớn (LLM) đóng vai trò quan trọng trong việc xử lý ngôn ngữ tự nhiên. Với khả năng học từ dữ liệu lớn và tái tạo ngôn ngữ tự nhiên, LLM đã và đang được áp dụng rộng rãi trong nhiều lĩnh vực như tạo văn bản, dịch ngôn ngữ, trả lời câu hỏi và tóm tắt văn bản.

Qua bài viết này, hy vọng bạn đã hiểu rõ hơn về Mô hình ngôn ngữ lớn (LLM), cấu trúc, ứng dụng, so sánh với các mô hình khác, hướng phát triển và tầm quan trọng của công nghệ này trong lĩnh vực xử lý ngôn ngữ tự nhiên. Chúc các bạn thành công trong việc nghiên cứu và ứng dụng LLM trong thực tế!